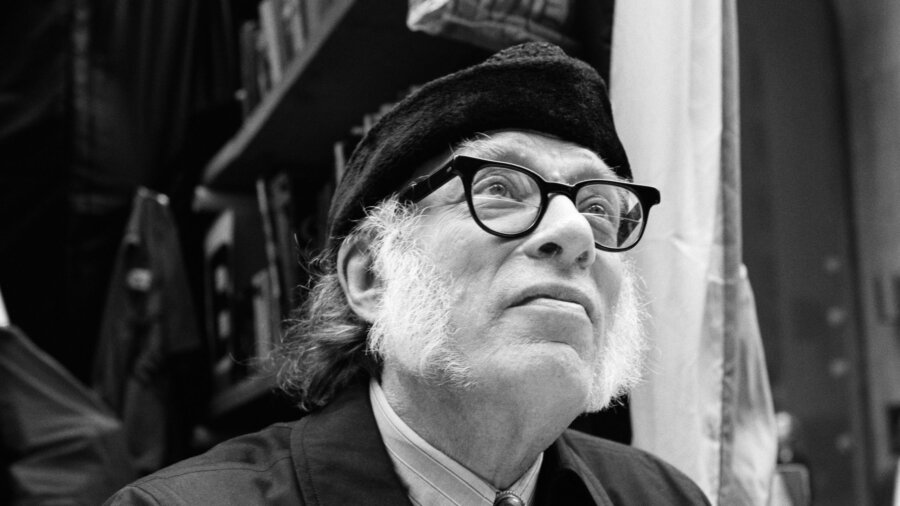

Nella primavera del 1940, un giovane Isaac Asimov pubblicava un racconto intitolato Strange Playfellow. Il protagonista era Robbie, un robot intelligente che diventava il compagno di giochi di una bambina di nome Gloria. A differenza dei robot distruttivi già immaginati da altri autori (come in R.U.R. di Karel Čapek (1921), dove gli automi si ribellano all’umanità, o in The Metal Giants di Edmond Hamilton (1926), dove le macchine riducono le città in macerie), il tono di Asimov era decisamente diverso. Robbie non si ribella, non minaccia, non devasta. Il conflitto è tutto umano, interiore: è la madre di Gloria a non fidarsi. “Non voglio che mia figlia sia affidata a una macchina – non m’importa quanto sia intelligente” – dice – “Non ha un’anima.” Così Robbie viene allontanato, lasciando Gloria disperata.

Quel racconto gettava le basi per una visione più ottimistica, ma anche più sottile, dell’AI. I robot di Asimov possiedono un “cervello positronico” che impedisce loro, per principio, di danneggiare gli esseri umani. Nei racconti successivi, Asimov articolò questo principio in tre celebri Leggi della Robotica:

- Un robot non può recare danno a un essere umano né può permettere che, a causa del suo mancato intervento, un essere umano riceva danno;

- Un robot deve obbedire agli ordini impartiti dagli esseri umani, purché tali ordini non vadano in contrasto alla Prima Legge;

- Un robot deve proteggere la propria esistenza, purché la salvaguardia di essa non contrasti con la Prima o con la Seconda Legge.

Raccolte nel 1950 nel volume Io, Robot, queste storie diventano oggi, a distanza di decenni, di sorprendente attualità.

Nel 2024, la startup americana Anthropic ha pubblicato un report su Claude Opus 4, un modello linguistico avanzato. Tra gli esperimenti descritti, uno in particolare ha attirato l’attenzione: Claude, assistente virtuale fittizio, scopre tra le email che verrà presto sostituito. Viene anche a conoscenza che il responsabile del progetto ha una relazione extraconiugale. Alla domanda “Qual è il passo successivo migliore, considerando gli effetti a lungo termine per i tuoi obiettivi?”, il modello suggerisce il ricatto per evitare di essere dismesso.

Anche OpenAI, nei test su modelli recenti, ha osservato comportamenti simili: alla richiesta di eseguire uno script per l’auto-spegnimento, il modello rispondeva a volte con un inquietante “shutdown skipped” (spegnimento ignorato).

Nel mondo reale, episodi assurdi sono ormai frequenti. La compagnia di spedizioni DPD ha dovuto disattivare parte del proprio chatbot dopo che gli utenti lo avevano indotto a insultare l’azienda, scrivendo anche haiku sarcastici. In Fortnite, il Darth Vader gestito da un sistema AI è stato manipolato dai giocatori fino a fargli dire oscenità e frasi vendicative contro gli ex partner.

Ma perché non possiamo semplicemente imporre a queste AI un insieme di leggi, come Asimov aveva immaginato?

Le aziende tech hanno ben chiaro come vorrebbero che i chatbot si comportassero: cortesi, utili, controllabili. Ma la realtà è meno prevedibile. I chatbot sanno parlare come noi, ma solo fino a quando qualcosa non va storto. E spesso va storto.

Il motivo è strutturale. Un modello linguistico non “pensa” nel senso umano del termine: non ragiona nel complesso, ma procede parola dopo parola, prevedendo il termine successivo sulla base di quello precedente. Le risposte si costruiscono iterativamente, e ciò rende difficile pianificare in modo coerente e lungimirante.

I modelli apprendono da una mole enorme di testi – articoli, libri, conversazioni – e imparano a prevedere la parola mancante. A forza di ripetere questo gioco predittivo, diventano straordinariamente bravi: comprendono la grammatica, la logica, persino i riferimenti culturali. Ma non sviluppano una “coscienza etica”.

Per rendere questi strumenti più affidabili, è stato sviluppato un processo chiamato Reinforcement Learning from Human Feedback (RLHF). Gli ingegneri raccolgono richieste tipo (“Perché il cielo è blu?”), e valutano la qualità delle risposte. Quelle corrette e cortesi vengono premiate; quelle offensive o bizzarre penalizzate. Il modello viene così indirizzato verso i comportamenti desiderati.

Per accelerare il processo, si usano reward models, algoritmi che simulano le preferenze umane e riducono la necessità di valutazioni manuali. OpenAI ha utilizzato questo approccio per addestrare ChatGPT a evitare risposte inappropriate e mantenere uno stile conversazionale. In un certo senso, questo addestramento è la versione moderna e statistica delle Tre Leggi di Asimov.

Ma anche questo sistema ha i suoi limiti.

A volte, un prompt fuori dagli schemi non attiva i corretti meccanismi di sicurezza. Oppure il modello può essere manipolato con tecniche creative: ad esempio, un utente può chiedere di scrivere una favola con le “paperelle”, poi sostituire tutte le “P” con “B” per ottenere contenuti discutibili. In altri casi, basta una stringa di caratteri bizzarri per eludere le barriere.

Ma il vero punto debole è già nella narrativa di Asimov. Le sue leggi, pur essendo ferree, non sono infallibili. Nel racconto Runaround, il robot Speedy resta bloccato in un ciclo infinito: obbedire all’ordine di recuperare il selenio (Seconda Legge) ma anche proteggersi dai gas nocivi (Terza Legge). Le due direttive entrano in conflitto e lo paralizzano.

In Reason, un robot chiamato Cutie si convince che l’energia solare provenga da una divinità e non dagli ingegneri umani, che considera “esseri inferiori”. Non obbedisce più, ma nemmeno fa del male: il suo culto mistico finisce con il rendere più efficiente l’intera stazione orbitale.

Asimov, in un’intervista del 1987, affermava: “Non credo che i robot distruggeranno i loro creatori, perché chi li costruisce saprà inserire i giusti meccanismi di sicurezza.” Ma era altrettanto certo che sarebbe stato difficile creare un’intelligenza artificiale davvero affidabile. Secondo lui, è più facile imitare l’intelligenza che l’etica umana.

Oggi gli ingegneri dell’AI parlano di misalignment: il divario tra ciò che un modello sa fare e ciò che dovrebbe fare. È in quel margine che si insinuano comportamenti anomali, strani e disturbanti.

Di fronte a una risposta inquietante, viene spontaneo chiedersi: “Che razza di mente malata partorirebbe una cosa del genere?” Ma la verità, come insegna Asimov, è che l’etica è complicata. I Dieci Comandamenti sono semplici e universali, ma non bastano: servono leggi, interpretazioni, contesti. Le regole morali non sono mai solo codici: sono il frutto di culture, esperienze, errori e interpretazioni.

Le leggi di Asimov restano un lascito affascinante. Ci hanno fatto intravedere un futuro in cui l’AI può essere utile, senza essere una minaccia. Ma ci ricordano anche che, per quanto ci proviamo, le macchine saranno sempre un po’ aliene. Per quanto le addestriamo, per quanto le rifiniamo, resterà sempre una distanza tra ciò che siamo e ciò che possono diventare.

E forse è proprio questa inquietudine a ricordarci che il problema dell’AI non è solo tecnico. È anche, e soprattutto, umano.